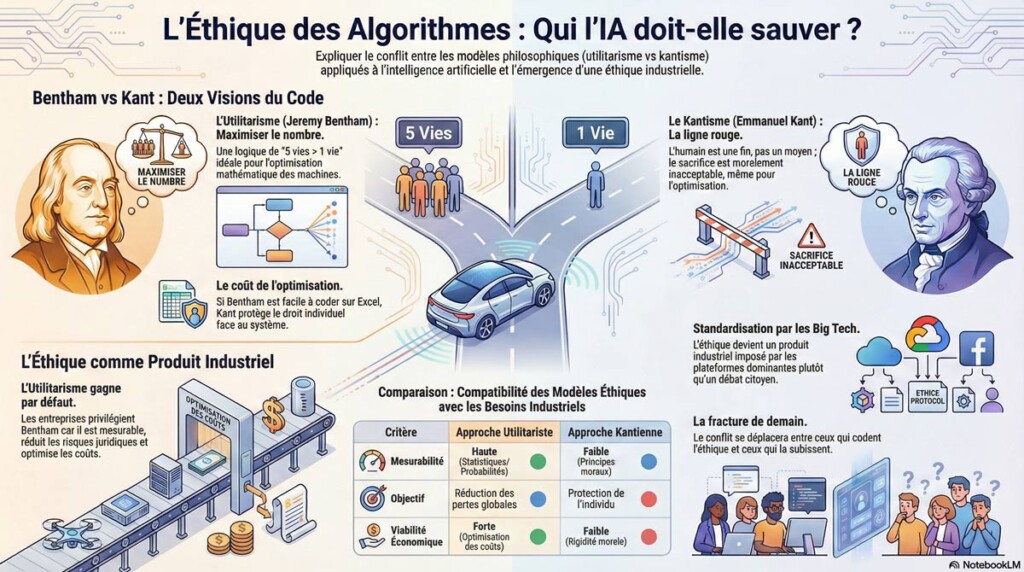

L’éthique n’est plus théorique, elle est industrielle

L’éthique n’est pas une affaire de bons sentiments.

C’est une architecture de décision, avec des gagnants, des perdants, et parfois des morts.

Le dilemme du tramway n’est plus un exercice de philosophie morale.

Il est aujourd’hui encodé dans des algorithmes, intégré aux véhicules autonomes, aux systèmes de tri médical, aux IA décisionnelles utilisées par les États et les entreprises.

Une question simple, brutale, incontournable :

👉 Faut-il sacrifier un individu pour optimiser un système ?

Le dilemme du tramway : la matrice morale des algorithmes

Un tramway lancé à pleine vitesse.

- Sur la voie principale : 5 ouvriers.

- Sur la voie secondaire : 1 seul homme.

Actionner l’aiguillage sauve cinq vies, en condamnant une.

Ce scénario, formalisé au XXᵉ siècle mais inspiré de débats bien plus anciens, structure aujourd’hui les discussions sur :

- l’éthique de l’IA,

- les véhicules autonomes,

- la prise de décision automatisée.

L’utilitarisme : optimiser le monde, quitte à broyer l’individu

Principe clé : maximiser le bien-être global

L’approche utilitariste repose sur une logique froide mais efficace :

Une action est morale si elle maximise l’utilité totale.

Référence fondatrice : Jeremy Bentham (XVIIIᵉ siècle).

Données clés

- Ratio moral : 5 vies > 1 vie

- Indicateur central : utilité (plaisir / souffrance)

- Logique dominante : optimisation des conséquences

Cette approche est massivement utilisée aujourd’hui, souvent sans le dire :

- triage médical en situation de crise,

- politiques publiques de santé,

- modèles de scoring algorithmique,

- décisions économiques à grande échelle.

👉 L’utilitarisme est scalable.

👉 Il est parfait pour les machines.

Mais il a un coût :

L’individu devient une variable d’ajustement.

Kant et l’impératif catégorique : la ligne rouge humaine

Changeons un seul paramètre.

Pour sauver les cinq personnes, vous devez pousser volontairement un homme sur la voie.

Résultat :

- Le calcul est identique.

- Le refus moral est massif.

Pourquoi ?

Parce que Kant introduit une rupture fondamentale.

Principe kantien

- Certains actes sont intrinsèquement immoraux.

- Un être humain ne peut jamais être utilisé comme un moyen, même pour un bien supérieur.

Obstacle moral majeur

- Absence de consentement

- Violation de la dignité humaine

- Destruction du droit individuel

👉 Le kantisme bloque l’optimisation totale, mais protège la personne.

👉 Il est moralement robuste, mais techniquement ingérable à grande échelle.

Quand la théorie tue : le naufrage de la Mignonette (1884)

La philosophie cesse d’être abstraite quand elle touche le réel.

Les faits

- 1884, naufrage du yacht Mignonette.

- 4 hommes à la dérive, sans nourriture.

- Après 19 jours, trois marins tuent le plus jeune pour survivre.

Le verdict : The Queen v. Dudley and Stephens

- La défense de nécessité est rejetée.

- Le meurtre reste un crime, même s’il sauve plusieurs vies.

Le cœur du problème

- Aucun consentement.

- Aucun tirage au sort.

- Une vie choisie, sacrifiée.

👉 La justice tranche :

L’utilité ne justifie pas tout.

IA, véhicules autonomes : Bentham est déjà dans le code

Aujourd’hui, la question n’est plus philosophique.

Elle est industrielle, économique et politique.

Exemple concret : véhicules autonomes

- Qui l’IA doit-elle protéger en priorité ?

- le passager ?

- le piéton ?

- le plus grand nombre ?

Une étude du MIT Moral Machine (2018) montre que :

- les préférences morales varient selon les cultures,

- mais que les systèmes tendent vers des choix utilitaristes par défaut.

Pourquoi ?

- Parce que l’optimisation est mesurable.

- Parce que la responsabilité juridique se dilue.

- Parce que les entreprises cherchent la solution statistiquement défendable, pas moralement parfaite.

👉 Bentham est compatible avec Excel. Kant ne l’est pas.

The Impakt Eye – L’analyse spéciale

Ne nous racontons pas d’histoires : l’utilitarisme va gagner par défaut.

Pas parce qu’il est moralement supérieur, mais parce qu’il est compatible avec le capitalisme algorithmique. Les IA décisionnelles — dans l’automobile, la santé, la finance ou la cybersécurité — seront jugées sur trois critères simples : performance, réduction du risque juridique, optimisation des coûts. Pas sur leur pureté morale.

À long terme, cela produit trois conséquences majeures :

- Standardisation morale par les grandes plateformes

Les acteurs dominants (Big Tech, constructeurs automobiles, fournisseurs d’IA) imposeront de facto leur cadre éthique, sous couvert de “meilleures pratiques”. L’éthique deviendra un produit industriel, pas un débat démocratique. - Prime financière aux IA “statistiquement défendables”

Les solutions capables de justifier leurs décisions par des métriques (taux de survie, réduction du risque global, conformité réglementaire) attireront les capitaux. Les modèles trop “rigides moralement” seront jugés non viables économiquement. - Déplacement du risque : de la machine vers le régulateur

Les entreprises pousseront les États à fixer des cadres moraux explicites, non par vertu, mais pour externaliser la responsabilité juridique. Celui qui écrit la règle contrôle le marché.

👉 Prédiction claire :

Dans 10 ans, l’éthique de l’IA sera moins un débat philosophique qu’un avantage compétitif mesurable, audité, monétisé.

La vraie fracture ne sera pas entre Kant et Bentham, mais entre les pays qui codent l’éthique et ceux qui la subissent.

Conclusion – L’éthique algorithmique n’est pas neutre (et ne le sera jamais)

Ne nous mentons pas.

Les systèmes d’IA ne seront pas kantien par nature.

Ils seront :

- utilitaristes,

- probabilistes,

- optimisés pour réduire les pertes globales.

La vraie question n’est donc pas :

Quelle morale est la meilleure ?

Mais plutôt :

Qui décide de la morale encodée ?

Une entreprise privée ? Un État ? Un comité d’experts ?

Refuser ce débat, c’est accepter une chose :

👉 Que des arbitrages moraux irréversibles soient délégués à des lignes de code, sans débat démocratique.

Le progrès technologique ne pose pas un dilemme moral.

Il l’impose.

FAQ

Sources & Références

- Bentham, Jeremy. An Introduction to the Principles of Morals and Legislation. Oxford University Press.

https://global.oup.com/academic/product/an-introduction-to-the-principles-of-morals-and-legislation-9780199553749 - Kant, Immanuel. Kant’s Moral Philosophy. Stanford Encyclopedia of Philosophy.

https://plato.stanford.edu/entries/kant-moral/ - MIT Media Lab. The Moral Machine Experiment (2018).

https://www.media.mit.edu/projects/moral-machine/ - Stanford Encyclopedia of Philosophy. Utilitarianism.

https://plato.stanford.edu/entries/utilitarianism/